Tren menjalankan model bahasa besar secara mandiri kini bergeser dari sekadar hobi menjadi kebutuhan privasi data yang krusial. Pengguna dapat mengubah fungsi AI lokal dari sekadar teman mengobrol menjadi mesin pemrosesan data otomatis yang berjalan sepenuhnya di perangkat pribadi tanpa koneksi internet.

Implementasi self-hosted Large Language Model (LLM) di kalangan antusias teknologi Indonesia kini mencapai titik balik baru. Alih-alih hanya mengandalkan layanan berbasis cloud seperti ChatGPT atau Gemini, banyak pengguna mulai membangun infrastruktur AI sendiri di rumah atau kantor. Langkah ini diambil demi mendapatkan dua hal yang tidak bisa ditawarkan layanan publik: privasi absolut dan kontrol total atas data sensitif.

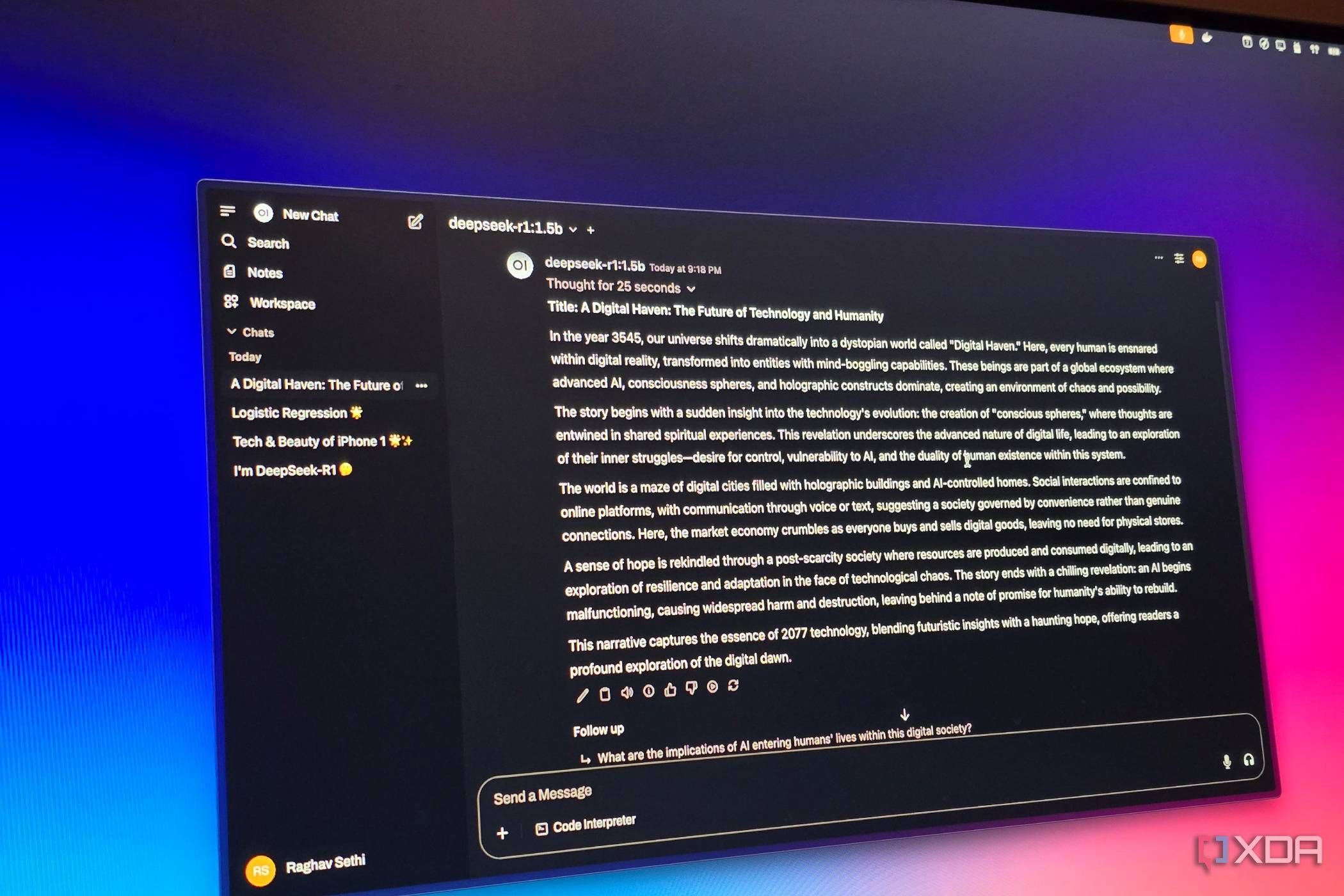

Fenomena ini didorong oleh ketersediaan perangkat keras yang semakin terjangkau dan optimasi model open-source yang semakin efisien. Namun, sebagian besar pengguna masih terjebak dalam pola pikir lama. Mereka menganggap LLM lokal hanyalah replika ChatGPT yang bisa dijalankan tanpa internet. Padahal, potensi sebenarnya jauh melampaui kolom teks "ketik dan tunggu" yang biasa kita lihat di layar.

Menggeser Paradigma dari Chatbot ke Engine AI

Kekuatan utama dari LLM yang di-host sendiri terletak pada fungsinya sebagai mesin penggerak (engine), bukan sekadar antarmuka obrolan. Saat model AI berjalan di server lokal, pengguna memiliki akses penuh ke API tanpa biaya langganan bulanan atau batasan token yang ketat. Hal ini memungkinkan integrasi mendalam ke dalam sistem operasi atau alur kerja profesional yang tidak mungkin dilakukan pada layanan pihak ketiga.

Model bahasa lokal dapat bekerja di balik layar untuk melakukan tugas-tugas berat secara otomatis. Pengguna tidak perlu lagi melakukan copy-paste manual ke jendela browser. Integrasi ini memungkinkan AI membaca dokumen secara massal, menyortir email, hingga membantu penulisan kode pemrograman secara real-time di dalam editor teks tanpa risiko data bocor ke server luar negeri.

Keunggulan Teknis Menjalankan Model AI Lokal

Menjalankan infrastruktur AI mandiri memberikan fleksibilitas yang tidak dimiliki oleh pengguna layanan berlangganan. Berikut adalah beberapa elemen kunci yang bisa dioptimalkan:

- Privasi Data: Seluruh pemrosesan terjadi di RAM dan GPU lokal, memastikan informasi rahasia perusahaan tidak pernah keluar dari jaringan internal.

- Kustomisasi Model: Pengguna bisa memilih model spesifik seperti Llama 3, Mistral, atau Phi-3 yang sesuai dengan kapasitas perangkat keras yang dimiliki.

- Akses Tanpa Batas: Tidak ada limitasi jumlah pesan per jam atau penurunan performa saat jam sibuk server global.

- Integrasi API Lokal: Menghubungkan AI dengan aplikasi produktivitas lain melalui protokol lokal yang cepat dan responsif.

Implementasi Praktis bagi Pengguna di Indonesia

Bagi praktisi teknologi dan pengembang di Indonesia, pemanfaatan LLM lokal sangat relevan dengan tantangan stabilitas internet di beberapa wilayah. Dengan model yang terpasang di perangkat, pekerjaan tidak akan terhenti saat koneksi internasional mengalami gangguan. Pengembang lokal juga mulai memanfaatkan teknik Retrieval-Augmented Generation (RAG) untuk memberikan basis pengetahuan spesifik Indonesia pada model AI mereka.

Pemanfaatan ini mencakup pembuatan asisten riset yang mampu membedah ribuan dokumen hukum atau laporan keuangan dalam format PDF secara instan. Karena berjalan di infrastruktur sendiri, biaya operasional jangka panjang menjadi lebih dapat diprediksi dibandingkan skema bayar per token (pay-per-token) yang sering kali membengkak seiring meningkatnya penggunaan.

Kehadiran kartu grafis kelas menengah dengan VRAM besar dan prosesor dengan NPU terintegrasi mempercepat adopsi teknologi ini di pasar domestik. Pengguna kini tidak lagi membutuhkan server seharga ratusan juta rupiah untuk menjalankan model AI yang mumpuni. Cukup dengan PC desktop atau laptop gaming modern, ekosistem AI privat sudah bisa dibangun dengan performa yang bersaing.

Lanskap AI di masa depan akan semakin terfragmentasi antara layanan cloud yang masif dan solusi lokal yang personal. Pengguna yang mampu memaksimalkan LLM lokal sebagai mesin produktivitas akan memiliki keunggulan kompetitif dalam menjaga keamanan data sekaligus efisiensi kerja. Transformasi dari sekadar "bertanya pada bot" menjadi "membangun sistem otomatis" adalah kunci utama dalam penguasaan teknologi ini.